P300-based BMIとは

ブレイン・マシン-インタフェース(Brain-Machine Interface, BMI)もしくは, ブレイン・コンピュータ-インタフェース(Brain-Computer Interface; BCI)は 前述のように 脳から生じる信号を機器の制御命令に変換するインタフェースです. BMIにはさまざまな種類がありますが, 私は重度の運動機能障碍者の自立や生活の質の向上に役立てることを考え, 頭皮から計測した脳波を用いて機器を精度よく機器を制御することのできるBMIの一つである P300-based BMIに焦点を当て,研究を行っております (P300-based BCI, P300型BMIとも呼ばれます).

P300-based BMIは,入力したい命令に対応する画像や音,

振動の出現を心の中で数えた際に生じる脳波を機器制御命令に変換するBMIです.

P300-based BMIを用いて文字入力を行うP300 spellerはその代表例です.

P300 spellerを右のGIFアニメーションを用いて説明します.

このシステムは脳波計,コンピュータ(PC),モニタから成ります.

ユーザの頭皮には脳波計測用の電極が取り付けられており,

BMIが操作できる状態となっております.

BMIを用いて文字を入力するため,

ユーザはモニタを見ながら以下の課題を行います.

- ユーザはBMIを用いて画面左上に表示された文字(Target)を

入力するよう指示されます.

今回は「J」を入力するように指示が与えられています. - 画面中央には灰色の文字が並んでいますが,

ユーザはその中の入力する文字を見つめ,それが白く光ったときに

心の中で数を数えます.

今回は画面中央付近にある灰色の「J」を見つめます. 灰色の文字は行ごと,列ごとに白く光りますので 入力する文字が光ったら心の中で数を数えます. 「J」が1回目出現したときに「1」,2回目出現したときに「2」 といった具合で口に出さず,指折りなどもせずに心の中で数えていきます. 今回は「J」の出現を合計6回数えます(典型的には30回分数えます). - BMIシステムは課題中に計測した脳波信号を解析して,ユーザが入力しようとした文字を推定し,

画面右上(Output)に結果を表示します.

ユーザの頭皮に電極が取り付けられており, 課題中の脳波信号は増幅され,PCに取り込まれます. PCでは脳波信号に信号処理や機械学習を施して, ユーザが入力しようとした文字を推定します. このBMIは低頻度の刺激に対して心の中で数を数えるといった 事象に関連してみられる脳波, すなわち事象関連電位(ERP)を活用します. 以上の課題を行った際,数える文字が白く変化した際の脳波を切り出し 平均をとると刺激呈示後300ミリ秒付近に頭のてっぺんを中心とした 大きな振幅を持つ脳波成分が見られます. これはP300と呼ばれるERPの成分の一つです(P3と呼ばれることもあります). このBMIはP300を含むERPを手掛かりにして ユーザが入力しようとした文字を推定しています. - 入力しようとした文字(Target)と,脳波から推定した文字(Output)が一致すれば入力成功です.

コンピュータから指示された文字が正しく入力できる状態となれば, 指示された文字だけでなく,ユーザは自分の好きなように文字が入力できるようになります. 文字を選択し画面に出力するだけでなく,車椅子を前後左右に動かす命令や, スマートホームの照明を点灯する命令, 挨拶文のリストの中から「こんにちは」を選びスピーカから再生する命令なども 用意することができます.

P300-based BMIは十分な訓練データと刺激提示時間があれば 多くのユーザが識別精度100%で操作できることが確認されています. この方式は上記の画面からの視覚刺激だけでなく,スピーカからの聴覚刺激, 手に付けた振動子からの触覚刺激を用いることができます. そのため,このBMIは目や耳,触覚のいずれかから情報を得られ, 意識がはっきりしている方が使用できると考えます. しかしながら,現状ではこのBMIはストレスなく自由に操作できるわけではないため, 実用化のためには,この方式の更なる改善が必要です. 例えば信号処理や機械学習を工夫した脳波信号検出技術の向上や, より区別しやすい脳波信号が得られる刺激の工夫などが必要です.

【より詳細にP300-based BMIの仕組みを学びたい方へ】

P300-based BMIの刺激呈示方法や識別方法の詳細は

「事象関連電位を用いたブレイン-コンピュータ・インタフェースのための集合識別器に関する研究」の3章

にて説明しています.

顔画像を用いたERP-based BMIに関する研究

これまでのP300-based BMIには灰色の文字が白く変わる刺激呈示方法が用いられてきました. また,このBMIは低頻度刺激に対して心の中で数を数える課題により得られる P300を含むERPを活用するBMIでした. しかし刺激方法を変更し,P300以外のERPの成分を活用すれば更なる性能向上が見込めます. 例えば,神経科学分野ではこれまで顔画像を呈示した際の脳波に関する研究が盛んになされており, Late Positive ComponentなどのP300以外の脳波成分が得られることが知られています. そのため,P300-based BMIの刺激に代わり,顔画像を用いた際のERPを活用したBMIを提案しました. このようにP300だけでなく他のERP成分を変化させるような刺激を用いたBMIを ERP-based BMIと呼ぶことにします.

提案する顔画像を用いたERP-based BMIの刺激の一例を右図のGIFアニメーションに示します. このBMIは八つの方向に関する命令を出力することを想定したBMIです. 例えば車椅子やロボットアームを八つの方向に制御することなどに適すると考えます. このシステムの操作方法は前述のP300 spellerと同様になります. まず,入力するよう指示を与える標的(Target)が画面中央に青色の矢印で示されます. ユーザは周囲の白い矢印の中から標的となる矢印に目を向けます. 白い矢印の上には顔画像が出現しますので, 標的となる白い矢印の上に顔画像が出現したら 心の中で数を数えます. このBMIでは合計二回数え,得られた脳波を解析します (顕著な脳波が出るユーザは一回数えるだけよい場合があります). ユーザが入力したい方向を脳波から読み取り, 画面中央に出力(Output)を緑色の矢印で示します. 標的と出力が一致すれば入力成功です.

私はこれまで顔画像を一種類呈示した場合,複数種類呈示した場合,矢印を呈示した場合を検討しました. さらに,それらをランダムな順序と時計回りの順序で呈示した場合を検討しました. その結果,顔画像の種類の違いや,提示する順序の違いによる違いは見られませんでしたが, 顔画像を呈示した場合に90%を超える識別精度が容易に得られることが明らかとなりました. この精度は矢印を用いた場合と比べて高い精度となります. 本研究成果は顔画像の導入によりBMIの精度が向上することを示唆します.

【関連業績】

- A. Onishi, Y. Zhang, Q. Zhao and A. Cichocki, “Fast and reliable P300-based BCI with facial images,” Proceedings of the 5th International Brain-Computer Interface Conference 2011, Graz, Austria, pp. 192-195, September 2011.

- Q. Zhao, A. Onishi, Y. Zhang, J. Cao, L. Zhang and A. Cichocki, “A novel oddball paradigm for affective BCIs using emotional faces as stimuli,” Proceedings of the 18th International Conference on Neural Information Processing, Shanghai, China, Lecture Notes in Computer Science, vol. 7062, pp. 279-286, November 2011.

- A. Onishi, A. H. Phan, K. Matsuoka and A. Cichocki, “Tensor classification for P300-based brain computer interface,” Proceedings of the 37th International Conference on Acoustics, Speech, and Signal Processing, Kyoto, Japan, pp. 581-584 , March 2012.

- Q. Zhao, Y. Zhang, A. Onishi, and A. Cichocki, “An affective BCI using multiple ERP components associated to facial emotion processing,” in Brain-Computer Interface Research, Springer, March 2013, pp. 61-72.

- 「感謝状」,理化学研究所理事長 野依良治,2011年11月.

- “Nomination for the annual BCI research award 2011,” Laboratory of Brain-Computer Interfaces, Institute for Knowledge Discovery, Graz University of Technology, September 2011.

P300-based BMIのための集合識別器に関する研究

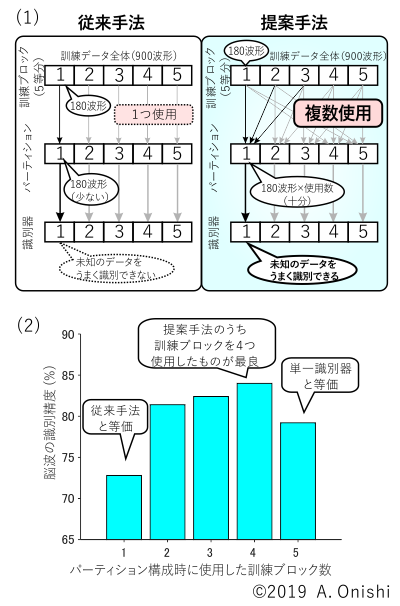

P300-based BMIの性能向上のためには,刺激提示のみならず,その識別方法の改善も必要です. これまでP300-based BMIの識別精度を競うコンペティション(BCI competition III data set II)が開かれ, サポートベクトルマシンを用いた集合識別器を用いた方法が優勝しました. その手法では右図(1)左側に示すように訓練データを5ブロックに分割し、別々の識別器を学習する方法が用いられました. しかし,訓練データが少ない場合には識別精度が低下することが危惧されます. このコンペティションは訓練データが15300波形(85文字分)と膨大な数が与えられていますが, この訓練データを計測するには約52分かかり,これを再現するとユーザに膨大な負担がかかります. 実際には実験でこれほど訓練データをとることはなく, 試験前の約3分程度(900波形,5文字分)で済ませるなど, より短時間で訓練データを計測するなど負担のない方法がとられています. 訓練データが900波形だけ与えられている場合に上記の手法を適用すると, 各識別器がたった180波形で学習せざるを得なくなるため, より少ない訓練データに対応した学習方法が必要であると考えます.

そこで私は右図(1)右側のように 訓練データブロックを複数使用して部分集合(パーティション)にし, 訓練データを重複して使用する学習方法を提案しました. 提案手法はまず与えられた訓練データを従来手法と同様に5等分し, これらを訓練ブロックと呼びます. 次に識別器を学習するためにブロックを複数個用いてパーティションを作ります. 各パーティションに対して識別器を学習し,結果を統合して出力を出します. このとき,訓練ブロック数が1であれば従来手法と等価であり, 訓練ブロック数が5であれば単一の識別器と等価になります. この性質を利用して,従来手法と単一の識別器,提案手法を比較しました.

訓練データを重複して使用する学習方法を用いた場合の 集合識別器の識別精度を右図(2)に示します. 訓練ブロックを4つ使用した際に提案手法が最も高い識別精度を示しました. 一方,訓練ブロックを1つ使用した従来手法と等価の場合には 識別精度が低下する場合があることが明らかとなりました. また,単一の識別器と比べても提案手法のほうが 高い識別精度を示す場合があることがわかりました. このように提案する集合識別器の学習手法を用いると、 少ない訓練データしか得られない場合でも従来手法より 精度よくする集合識別器を学習することが可能です.

【関連業績】

- A. Onishi and K. Natsume, “Ensemble regularized linear discriminant analysis classifier for P300-based brain-computer interface,” Proceedings of the 35th Annual International Conference of the IEEE Engineering in Medicine and Biology Society, Osaka, Japan, pp. 4231–4234, July 2013.

- A. Onishi and K. Natsume, “A new online event related potential based brain-computer interfaces using an ensemble classifier,” Proceedings of the 6th International IEEE/EMBS Conference on Neural Engineering, California, the United States, pp. 1033–1036, November 2013.

- A. Onishi and K. Natsume, “Overlapped partitioning for ensemble classifiers of P300-based brain computer interfaces,” PLoS ONE, Public Library of Science, vol. 9, no. 4, p. e93045, April 2014.

- 「事象関連電位を用いたブレイン-コンピュータ・インタフェースのための集合識別器に関する研究」,九州工業大学,博士論文,2015.

情動音を用いたBMIに関する研究

これまでP300-based BMIの刺激には視覚刺激が多用されてきました. しかし,目が見えない方や,視線を自由に制御できない方が 視覚刺激を用いたBMIを使うのは難しいため, 聴覚などの代替の感覚刺激を用いたBMIがあることが望ましいと考えます. これまで聴覚刺激を用いたP300-based BMIが提案されてきましたが 視覚刺激を用いた場合と比べて識別精度が低いといった問題がありました. そこで,一時的な感情の変化を生み出す情動音を導入たERP-based BMIを提案し, その効果を調べました.

提案する情動音を用いたERP-based BMIを右図のGIFアニメーションに示します. このBMIを用いると,音の出現を数えて「はい」か「いいえ」の返事を行うことができます. まず,「はい」か「いいえ」で返事をすることのできる質問をスピーカーから流します. 例えば「キリンの首は長いですか?」といった質問を用意します (念のため事前にその回答が「はい」であることをユーザに確認します). その質問の音声をスピーカから再生して,ユーザに質問を伝えます. つぎに,以下の3種類の音をランダムにスピーカから再生します.

- 「ニャー」(猫の甘えた声):「はい」に対応するポジティブな情動音

- 「ギャー」(猫の怒った声):「いいえ」に対応するネガティブな情動音

- 「ピー」(関係のない音):「はい」にも「いいえ」にも対応しない音

情動音による効果を調べるため, 音を細かく切って順序を入れ替えたスクランブル再生した音を用意し, 通常再生した場合と,スクランブル再生した場合のBMIの識別器や, 音に対しどの程度ポジティブ/ネガティブに感じるかを調べた内観値の比較を行いました. その結果.ポジティブな情動音は通常再生時に識別精度,内観値ともに有意に高い値を示しました. 一方,ネガティブな情動音は内観値が再生の種類によらずネガティブとなり, 識別精度にも有意差がみられませんでした. これより情動音の内観値が正か負を示した場合, P300-BMIの識別精度が向上することを示唆する結果が得られました. さらに,筋萎縮性側索硬化症(ALS)の患者1名が本BMIを識別精度90%で操作することに成功しました.

【関連業績】

- A. Onishi, K. Takano, T. Kawase, H. Ora, K. Kansaku, “Affective stimuli for an auditory P300 brain-computer interface,” Frontiers in Neuroscience, vol. 11, p. 552, September 2017.

- A. Onishi, H. Ora, and K. Kansaku, “Affective sounds applied to auditory P300 brain-machine interface,” Abstract of the 39th Annual Meeting of the Japan Neuroscience Society, Kanagawa, Japan, July 2016.

- A. Onishi, S. Halder and K. Kansaku, “An affective brain-machine interface using tasks with emotion and memory recall,” Abstract of the 38th Annual Meeting of the Japan Neuroscience Society, Meeting planner, Hyogo, Japan, July 2015.

- 大西章也,大良宏樹,Sebastian Halder,神作憲司, 「BMIを用いたコミュニケーション補助における情動刺激の効果」, 第32回国立障害者リハビリテーションセンター業績発表会, 国立障害者リハビリテーションセンター,埼玉,2016年12月18日.

- 大西章也, 「情動音を用いたブレイン・マシン・インタフェースの開発」, 千葉大学フロンティア医工学センター第80回医工学研究会,2017年7月28日.

ポジティブとネガティブの程度の違いが情動音BMIに及ぼす影響

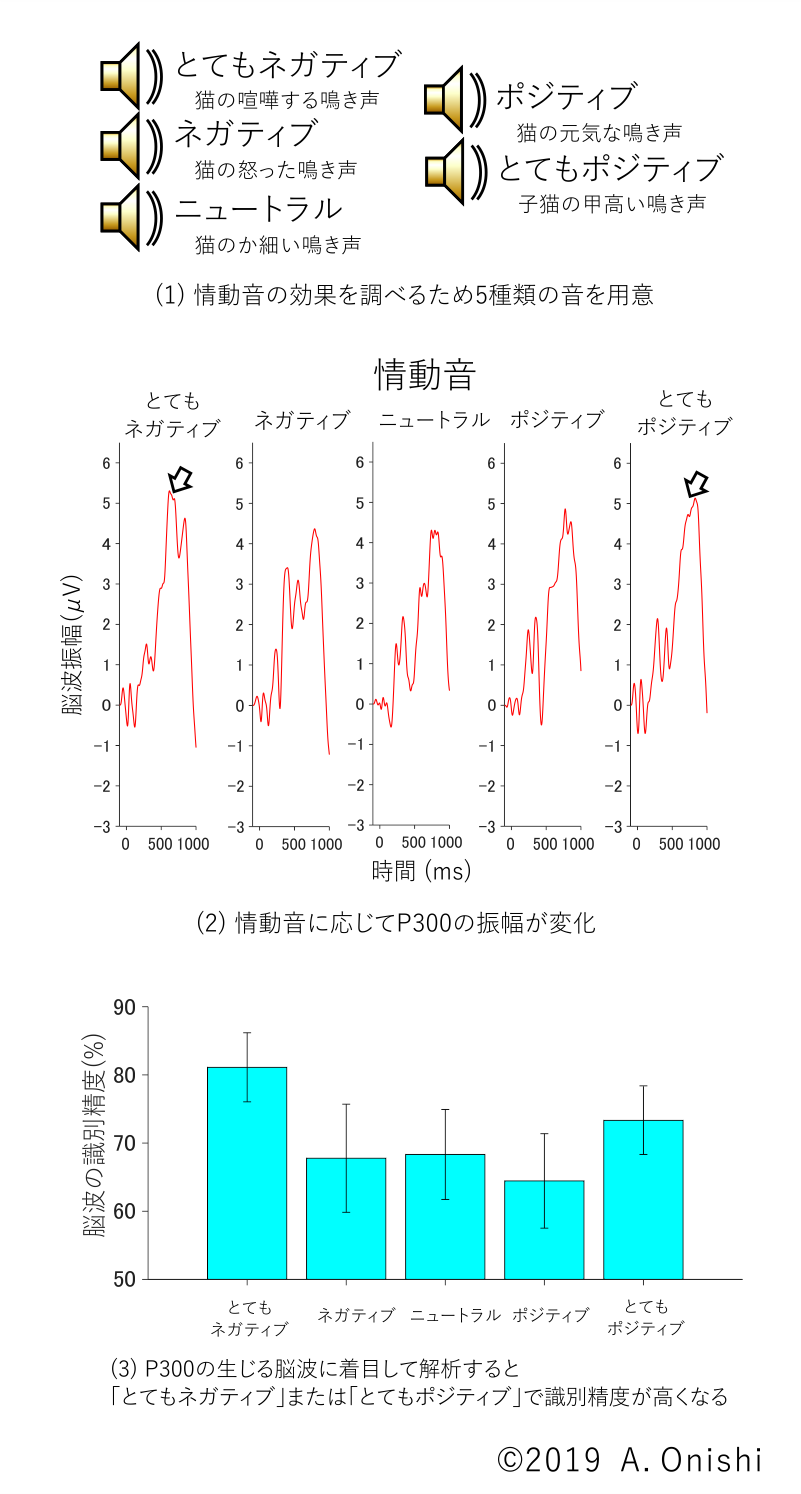

これまで情動音によりERP-based BMIの識別精度が向上することを示唆する結果が得られました. そのBMIではポジティブな情動音とネガティブな情動音の2種類に着目しましたが, 情動のポジティブやネガティブの程度の違いがBMIにどのように影響を及ぼすのでしょうか. そこで,右図(1)のように「とてもネガティブ」から「とてもポジティブ」まで5段階の情動音を用意し, ERP-based BMIの識別精度に与える影響を調べました.

5段階の情動音それぞれに着目してERPの平均波形を求めたものを右図(2)に示します. このように,「とてもネガティブ」と「とてもポジティブ」で顕著なP300の振幅が得られました. さらに,それらに対応するERPを用いて識別精度を計算した結果を右図(3)に示します. その結果,「とてもネガティブ」と「とてもポジティブ」の情動音を用いた場合, 他のものより有意に識別精度が高くなることがわかりました. 本研究成果は情動音がニュートラル(中間)から離れると識別精度が高くなることを示唆しています.

【関連業績】

- A. Onishi, S. Nakagawa, “How does the degree of valence influence affective auditory P300-based BCIs?” Frontiers in Neuroscience, vol. 13, p.45, February 2019.

- A. Onishi, S. Nakagawa, “Comparison of Classifiers for the Transfer Learning of Affective Auditory P300-Based BCIs,” Proceedings of the 41th Annual International Conference of the IEEE Engineering in Medicine and Biology Society, pp. 6766-6769, Berlin, Germany, July 2019. (Peer reviewed, Oral presentation)

- A. Onishi, S. Nakagawa, “Ensemble Convoluted Feature Extraction for Affective Auditory P300 Brain-Computer Interfaces,” Proceedings of the 40th Annual International Conference of the IEEE Engineering in Medicine and Biology Society, pp. 1948-1951, Honolulu, HI, July 2018.

- 大西章也,中川誠司, 「情動音を用いたブレイン・マシン・インタフェースの取組み」, 第16回千葉大学医工学シンポジウム, 千葉大学,2018年11月20日.